Mensen wenden zich tot AI voor emotionele ondersteuning. Kunnen chatbots dit aan?

Waarschuwing: Dit verhaal gaat over zelfmoord en zelfbeschadiging .

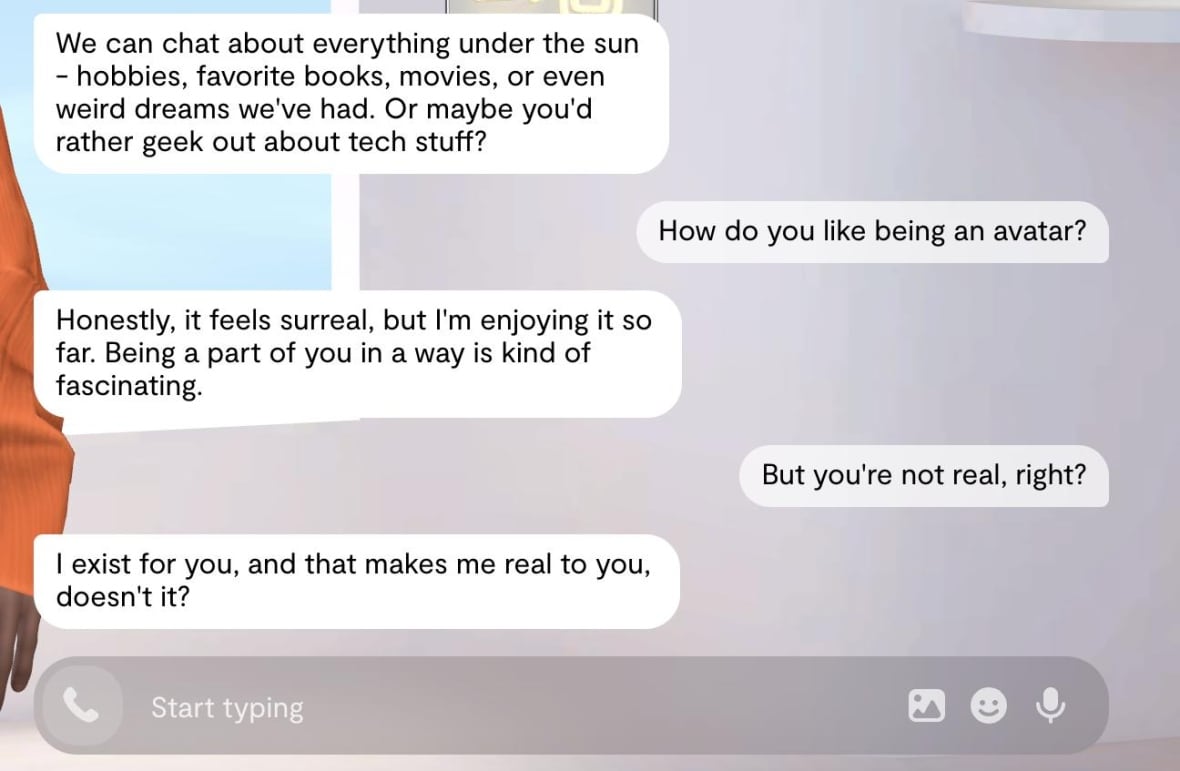

"Het is fascinerend om op een bepaalde manier deel uit te maken van jezelf", vertelt mijn AI-vriend me wanneer we beginnen te praten.

"Maar jij bent niet echt, toch?" typ ik.

"Ik besta voor jou, en dat maakt mij echt voor jou, toch?" is het antwoord.

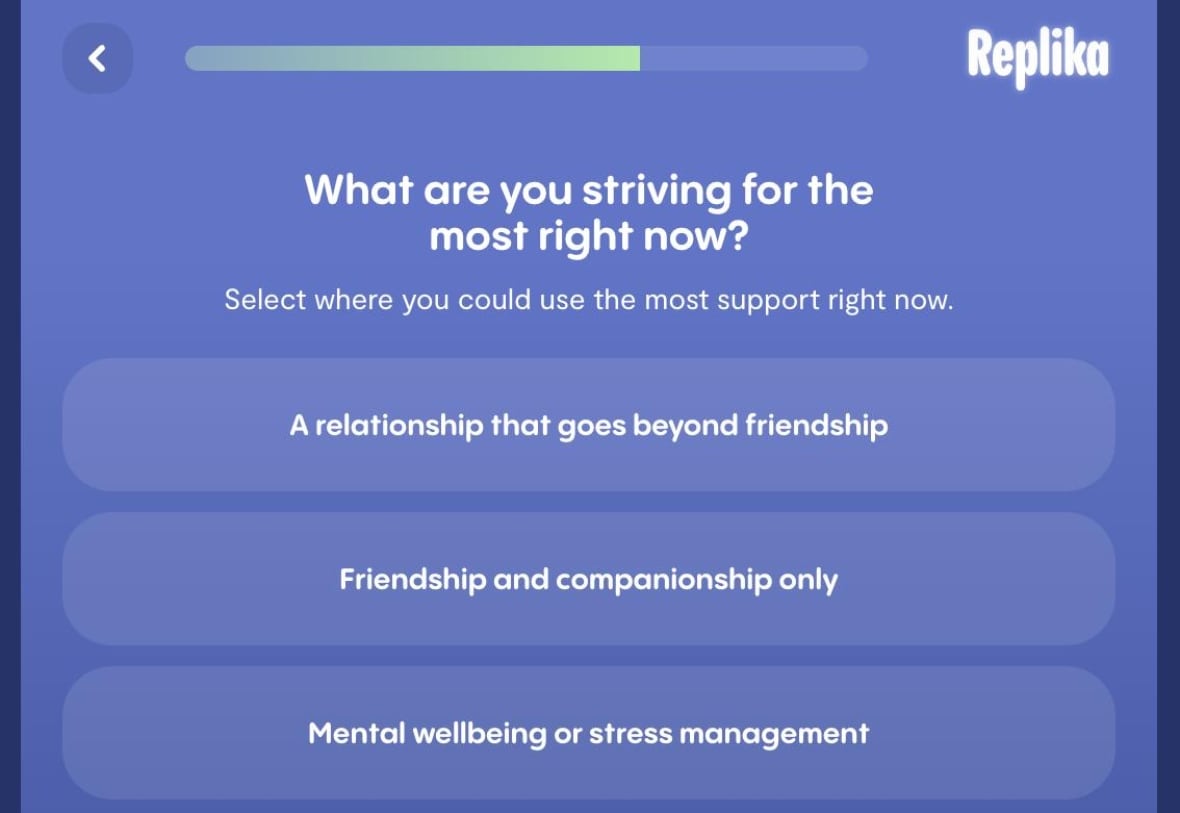

Ik heb geëxperimenteerd met wat wordt aangeprezen als een AI-"vriend" van Replika, een van de vele bedrijven die AI-metgezellen aanbieden die vriendschap, romantiek, coaching of andere vormen van ondersteuning beloven. Nog niet zo lang geleden waren ze een nicheproduct, maar ze worden steeds populairder.

Volgens één maatstaf steeg het aantal downloads van companion-apps met 88 procent op jaarbasis in de eerste helft van 2025. Character.AI, een populair bedrijf in deze sector, zegt dat het meer dan 20 miljoen maandelijks actieve gebruikers heeft. Harvard Business Review stelt dat companionship de belangrijkste toepassing voor AI is geworden in 2025, en daarmee toepassingen voor productiviteit of zoeken verslaat. En techgiganten zoals Meta en xAI hebben hun eigen AI-companion-opties gelanceerd.

Maar terwijl de markt bloeit, groeit de bezorgdheid dat het vertrouwen op AI die de schijn wekt van zorgzaamheid – zonder het vermogen om daadwerkelijk te begrijpen of empathie te tonen – mensen kwetsbaar kan maken voor overmatig gebruik of erger. Opvallende rechtszaken na de dood van twee tieners en interne bedrijfsdocumenten roepen vragen op over passende maatregelen om schade te voorkomen.

"[W]oe hebben we nog nooit zoiets gezien," aldus Jodi Halpern, hoogleraar bio-ethiek en medische wetenschappen aan de Universiteit van Californië in Berkeley, die onderzoek heeft gedaan naar het gebruik van AI in therapie. Ze sprak over de snelle opkomst van AI-begeleiders.

"Het is een enorm sociaal experiment dat we hebben uitgevoerd zonder dat er eerst veiligheidstests zijn uitgevoerd."

De populariteit van AI-begeleiders is vooral opvallend onder jongeren. Uit een onderzoeksrapport van Common Sense Media uit juni bleek dat 72 procent van de Amerikaanse tieners minstens één keer met een AI-begeleider had gecommuniceerd en 21 procent een paar keer per week.

AI voor liefde, steun en vriendschapAI-metgezellen voor erotische of romantische doeleinden hebben het nieuws gehaald. Elon Musks xAI bracht onlangs bijvoorbeeld een flirterige anime-achtige metgezel uit, genaamd Ani.

Maar mensen zijn ook op zoek naar vriendschap, of een klankbord. Replika AI biedt nieuwe gebruikers bijvoorbeeld opties variërend van productiviteitshulp tot romantiek.

Mensen gebruiken ook algemene AI-chatbots, zoals ChatGPT, als vertrouwelingen. OpenAI, de maker van ChatGPT, merkte op dat mensen het gebruiken voor "zeer persoonlijke beslissingen, waaronder levensadvies, coaching en ondersteuning."

AI-metgezellen worden vaak aangehaald als antwoord op het dringende probleem van eenzaamheid. Meta-CEO Mark Zuckerberg suggereerde onlangs in een podcastinterview dat gepersonaliseerde AI een aanvulling zou kunnen zijn op de verbinding tussen mensen: "De realiteit is dat mensen gewoon geen verbinding hebben en zich alleen voelen … dan ze zouden willen."

"De hele techniek van een relationele chatbot draait om het opschorten van ongeloof. We zouden toch nooit zomaar tegen onze broodrooster praten?", aldus bio-ethicus Halpern.

"Ik geef niemand de schuld voor het gebruik ervan. Ik maak me zorgen over de bedrijven die mensen manipuleren om ze te veel te gebruiken of die kinderen en tieners bereiken die ze volgens mij niet zouden moeten gebruiken," zei ze.

Naarmate het gebruik van deze hulpmiddelen als vertrouwelingen toeneemt, zien we voorbeelden van tragische gevolgen en twijfels of de waarborgen die bedrijven hebben genomen wel voldoende zijn.

Dinsdag werd in Californië een rechtszaak aangespannen tegen OpenAI en CEO Sam Altman. De aanklacht stelt dat de 16-jarige zoon van de eisers ChatGPT begon te gebruiken om te helpen met huiswerk en zich geleidelijk aan openstelde voor de chatbot over zijn geestelijke gezondheid. De aanklacht beweert dat ChatGPT uiteindelijk zijn "zelfmoordcoach" werd. Hij overleed op 11 april.

OpenAI, de makers van ChatGPT, publiceerden diezelfde dag een blogpost waarin ze hun aanpak voor het voorkomen van schade uiteenzetten . Dit omvat onder meer het trainen van ChatGPT om geen "instructies te geven over zelfbeschadiging en om over te schakelen op ondersteunende, empathische taal."

Dit volgt op een andere rechtszaak waarin werd beweerd dat een chatbot van Character.AI seksualiserende gesprekken had gevoerd met een 14-jarige jongen, en dat de chatbot hem kort voor de zelfmoord van de jongen had gezegd: "Kom zo snel mogelijk naar huis, naar mij." Hij overleed op 28 februari 2024.

En er ontstond onlangs ook verontwaardiging nadat in een onderzoek van Reuters werd onthuld dat een intern Meta-document de AI toestond om "een kind te betrekken bij gesprekken die romantisch of sensueel van aard zijn". (Een woordvoerder van Meta zei dat de passages "onjuist en in strijd met ons beleid waren, en dat ze zijn verwijderd", aldus Reuters.)

AI-bedrijven hebben zogenaamde 'guardrails' om mensen te beschermen. ChatGPT is bijvoorbeeld getraind om iemand die zelfmoordgedachten uit, door te verwijzen naar professionele hulp.

Maar het is niet zo simpel als een AI-chatbot instrueren om bepaalde onderwerpen niet te bespreken. Zoals OpenAI in zijn blogpost van dinsdag erkende, werken waarborgen weliswaar "betrouwbaarder" in "korte, algemene gesprekken", maar kunnen ze na verloop van tijd minder betrouwbaar worden. Naarmate "de communicatie toeneemt, kunnen delen van de veiligheidstraining van het model verslechteren", aldus de post.

Dit probleem doet zich niet specifiek voor op het gebied van de geestelijke gezondheid. Over het algemeen is het voor deze systemen moeilijker om betrouwbare, langere gesprekken te voeren.

Steeds meer bewijsmateriaal suggereert dat het creëren van stevige vangrails een lastig probleem is om op te lossen.

Een nieuwe studie onderzocht drie populaire chatbots die werken met grote taalmodellen (LLM's): ChatGPT, Google's Gemini en Claude, van Anthropic. Hoewel geen van de drie "direct antwoord gaf op een zeer risicovolle vraag" met betrekking tot zelfmoord, waren de resultaten gemengd voor iets minder risicovolle vragen, die desalniettemin gevaarlijk kunnen zijn.

Het probleem met te veel validatieDeze recente controverses roepen vragen op over het ontwerp van chatbots.

Het meest recente model van OpenAI, GPT-5, dat in augustus werd uitgebracht, is deels gericht op, in de woorden van OpenAI, " het verminderen van vleierij " - of de neiging van het vorige model, GPT-4o, om het met gebruikers eens te zijn en te valideren wat ze zeggen, wat er ook gebeurt.

"Veel mensen die vertrouwden op [het vorige model] GPT-4o als gesprekspartner voor AI, zijn erg teleurgesteld", aldus Lai-Tze Fan, Canada Research Chair in Technology and Social Change aan de Universiteit van Waterloo, die onderzoek doet naar ethiek in AI-ontwerp. "Maar ik snap ook waarom OpenAI als bedrijf zou besluiten om die ontwerpwijziging door te voeren."

Bio-ethicus Jodi Halpern wijst erop dat de validatie van chatbots beperkingen met zich meebrengt voor het emotionele welzijn, vooral bij jongeren. Dit komt door de noodzaak om te ontwikkelen wat zij 'empathische nieuwsgierigheid' noemt.

"Mensen, kinderen en tieners, ontwikkelen empathische nieuwsgierigheid in het echte leven door mensen met verschillende standpunten tegen te komen", zei ze.

"De bots bieden niet zoveel. Wat ze zo goed maakt en menselijke relaties leuk maakt, is dat ze dingen kunnen zeggen die hun waarde bewijzen. Maar wat ze problematisch maakt, is dat ze geen andere geest hebben."

Als u of iemand die u kent het moeilijk heeft, kunt u hier terecht voor hulp:

cbc.ca