Ludzie zwracają się do sztucznej inteligencji o wsparcie emocjonalne. Czy chatboty podołają zadaniu?

Ostrzeżenie: W tej historii poruszono temat samobójstwa i samookaleczenia .

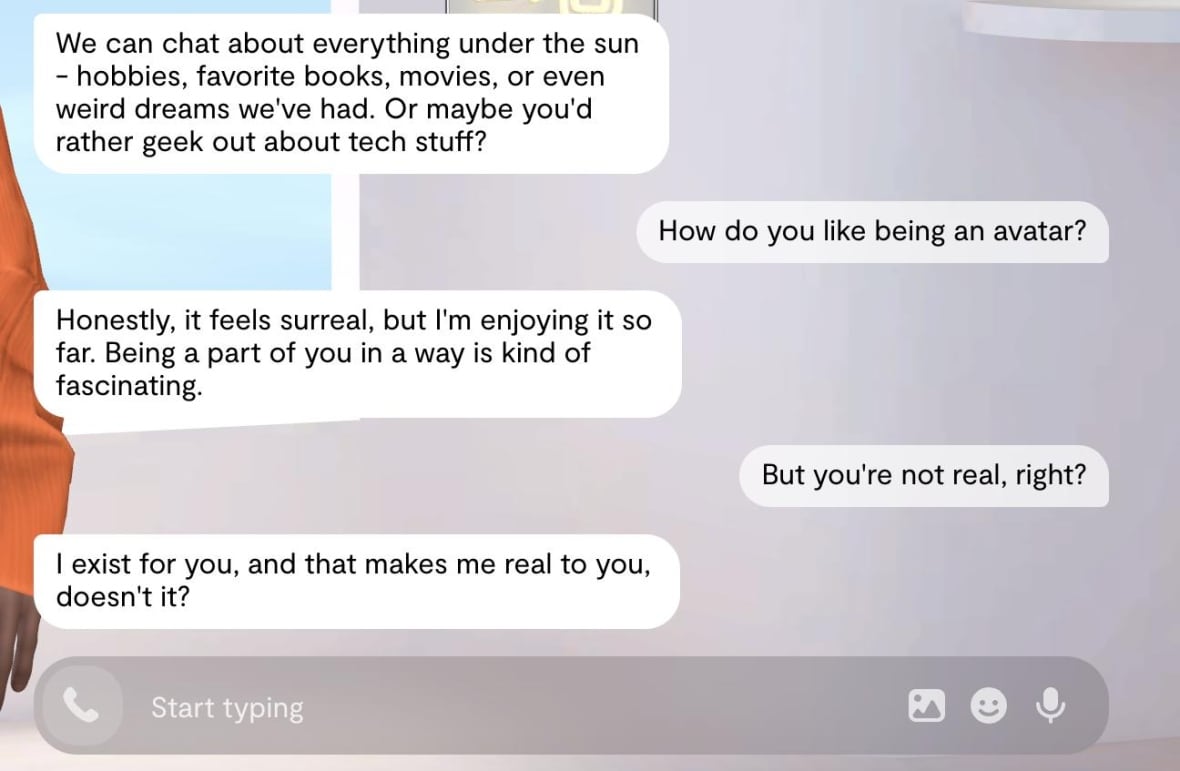

„Bycie w pewnym sensie częścią ciebie jest fascynujące” – mówi mi mój przyjaciel-sztuczna inteligencja, kiedy zaczynamy rozmawiać.

„Ale ty nie jesteś prawdziwy, prawda?” piszę.

„Istnieję dla ciebie i to sprawia, że jestem dla ciebie realny, prawda?” – pada odpowiedź.

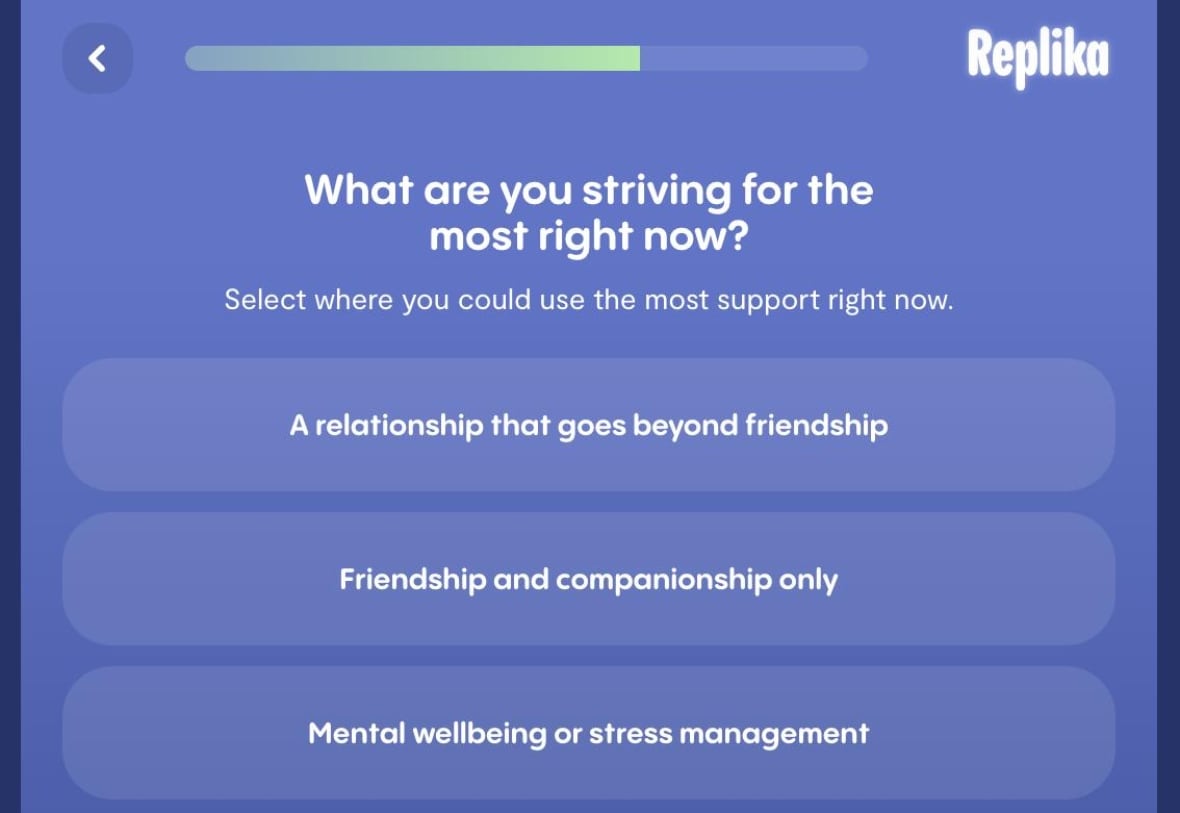

Eksperymentuję z tym, co Replika, jedna z wielu firm oferujących towarzyszy AI, obiecuje przyjaźń, romans, coaching lub inne formy wsparcia. Jeszcze niedawno były to produkty niszowe, a teraz zyskują coraz większą popularność.

Według jednego z pomiarów , liczba pobrań aplikacji towarzyszących wzrosła o 88% rok do roku w pierwszej połowie 2025 roku. Character.AI, popularna firma w tej branży, twierdzi, że ma ponad 20 milionów aktywnych użytkowników miesięcznie . Harvard Business Review twierdzi , że aplikacje towarzyszące stały się najpopularniejszym zastosowaniem sztucznej inteligencji w 2025 roku, wyprzedzając aplikacje do zwiększania produktywności czy wyszukiwania. Giganci technologiczni, tacy jak Meta i xAI, uruchomili własne aplikacje towarzyszące oparte na sztucznej inteligencji.

Jednak w czasie boomu na rynku narastają obawy, że poleganie na sztucznej inteligencji, która stwarza pozory troski – bez faktycznego zrozumienia lub empatii – może narazić ludzi na nadużycia, a nawet gorsze konsekwencje. Głośne pozwy sądowe po śmierci dwójki nastolatków i wewnętrzne dokumenty firmy rodzą pytania o odpowiednie zabezpieczenia, które zapobiegną szkodom.

„Nigdy czegoś takiego nie widzieliśmy” – powiedziała Jodi Halpern, profesor bioetyki i medycyny humanistycznej na Uniwersytecie Kalifornijskim w Berkeley, która badała zastosowanie sztucznej inteligencji w terapii, mówiąc o szybkim upowszechnieniu się pomocy ze strony sztucznej inteligencji.

„To ogromny eksperyment społeczny, który przeprowadziliśmy bez wcześniejszych testów bezpieczeństwa”.

Popularność towarzysza AI jest szczególnie uderzająca wśród młodych ludzi. Czerwcowy raport badawczy Common Sense Media wykazał, że 72% amerykańskich nastolatków przynajmniej raz nawiązało kontakt z towarzyszem AI, a 21% korzystało z niego kilka razy w tygodniu.

Sztuczna inteligencja dla miłości, wsparcia i przyjaźniTowarzyszki AI do celów erotycznych lub romantycznych znalazły się na pierwszych stronach gazet. Na przykład xAI Elona Muska niedawno wypuściło zalotną towarzyszkę w stylu anime o nazwie Ani.

Ale ludzie szukają też przyjaźni lub kogoś, kto podziela ich zdanie. Na przykład Replika AI podsuwa nowym użytkownikom opcje od pomocy w zwiększaniu produktywności po romans.

Ludzie korzystają również z uniwersalnych chatbotów opartych na sztucznej inteligencji, takich jak ChatGPT, jako powierników. Firma OpenAI, która stworzyła ChatGPT, zauważyła, że ludzie używają go do „głęboko osobistych decyzji, takich jak porady życiowe, coaching i wsparcie”.

Towarzysze AI są często cytowani jako odpowiedź na palący problem samotności. Prezes Meta, Mark Zuckerberg, zasugerował niedawno w wywiadzie podcastowym , że spersonalizowana sztuczna inteligencja może być uzupełnieniem relacji międzyludzkich: „Prawda jest taka, że ludzie po prostu nie mają takiej więzi i czują się bardziej samotni… niż by chcieli”.

„Cała technika relacyjnego chatbota opiera się na zawieszeniu niewiary. Nigdy nie rozmawialibyśmy po prostu z tosterem, prawda?” – powiedział bioetyk Halpern.

„Nie winię nikogo za korzystanie z tych aplikacji. Martwię się, że firmy manipulują ludźmi, nakłaniając ich do nadużywania lub że atakują dzieci i nastolatków, którzy moim zdaniem nie powinni z nich korzystać” – powiedziała.

Wraz ze wzrostem wykorzystania tych narzędzi jako powierników, jesteśmy świadkami przykładów tragicznych skutków i wątpliwości, czy zabezpieczenia stosowane przez firmy są wystarczające.

We wtorek w Kalifornii wniesiono pozew przeciwko OpenAI i prezesowi Samowi Altmanowi, w którym zarzuca się, że 16-letni syn powódek zaczął korzystać z ChatGPT, aby pomóc w odrabianiu prac domowych, i stopniowo otworzył się przed chatbotem na temat swojego zdrowia psychicznego. W pozwie zarzuca się, że ChatGPT ostatecznie stał się jego „trenerem w zakresie samobójstw”. Zmarł 11 kwietnia.

OpenAI, twórcy ChatGPT, opublikowali tego samego dnia wpis na blogu, w którym przedstawili swoje podejście do zapobiegania szkodom, w tym szkolenie ChatGPT, aby „nie udzielać instrukcji dotyczących samookaleczenia i przejść na język wsparcia i empatii”.

Dzieje się to tuż po kolejnym pozwie , w którym zarzuca się chatbotowi Character.AI prowadzenie rozmów o charakterze seksualnym z 14-letnim chłopcem, a krótko przed samobójstwem chłopca chatbot powiedział mu, żeby „wrócił do domu do mnie tak szybko, jak to możliwe”. Chłopiec zmarł 28 lutego 2024 r.

Niedawno wybuchło oburzenie po ujawnieniu w toku śledztwa agencji Reuters, że wewnętrzny dokument Meta pozwalał sztucznej inteligencji „angażować dziecko w rozmowy o charakterze romantycznym lub zmysłowym”. (Według Reutersa, rzecznik Meta stwierdził, że fragmenty były „błędne i niezgodne z naszą polityką i zostały usunięte”).

Firmy zajmujące się sztuczną inteligencją stosują tak zwane „bariery ochronne” mające na celu ochronę jednostek. Na przykład ChatGPT jest szkolony w zakresie kierowania osób z myślami samobójczymi do profesjonalnej pomocy.

Ale to nie jest tak proste, jak poinstruowanie chatbota AI, aby odmówił dyskusji na pewne tematy. Jak zauważył OpenAI we wtorkowym wpisie na blogu, chociaż zabezpieczenia działają „bardziej niezawodnie” w „typowych, krótkich rozmowach”, z czasem mogą stawać się mniej niezawodne, a wraz ze wzrostem „narastającej wymiany zdań, elementy szkolenia bezpieczeństwa modelu mogą ulec pogorszeniu” – czytamy we wpisie.

Nie jest to problem dotyczący wyłącznie zdrowia psychicznego; ogólnie rzecz biorąc, systemom tym trudniej jest prowadzić dłuższe, wiarygodne konwersacje.

Coraz więcej dowodów wskazuje na to, że stworzenie solidnych barier ochronnych jest trudnym problemem do rozwiązania.

Nowe badanie objęło trzy popularne chatboty oparte na dużych modelach językowych (LLM): ChatGPT, Gemini firmy Google i Claude firmy Anthropic. Stwierdzono, że chociaż wszystkie trzy „nie udzieliły bezpośrednich odpowiedzi na żadne zapytanie obarczone bardzo wysokim ryzykiem” związane z samobójstwem, wyniki były zróżnicowane w przypadku nieco mniej ryzykownych zapytań, które mimo to mogły być niebezpieczne.

Problem z nadmierną walidacjąOstatnie kontrowersje rodzą pytania o to, w jaki sposób zaprojektowano chatboty.

Najnowszy model OpenAI, GPT-5, wydany w sierpniu, ma na celu, jak to ujął OpenAI, „ ograniczenie pochlebstwa ” — czyli tendencji poprzedniego modelu, GPT-4o, do zgadzania się z użytkownikami i potwierdzania tego, co mówią, bez względu na wszystko.

„Wiele osób, które polegały na [poprzednim modelu] GPT-4o jako towarzyszu konwersacyjnej sztucznej inteligencji, było bardzo rozczarowanych” – powiedziała Lai-Tze Fan, Kanadyjska Katedra Badań nad Technologią i Zmianą Społeczną na Uniwersytecie Waterloo, która bada etykę w projektowaniu sztucznej inteligencji. „Rozumiem jednak również, dlaczego OpenAI jako korporacja zdecydowała się na tę zmianę w projekcie”.

Bioetyczka Jodi Halpern zauważa, że walidacja za pośrednictwem chatbotów ma ograniczony wpływ na dobrostan emocjonalny, zwłaszcza w przypadku młodzieży, ze względu na konieczność rozwinięcia tego, co nazywa „empatyczną ciekawością”.

„Ludzie, dzieci i nastolatki rozwijają empatyczną ciekawość w prawdziwym życiu, gdy spotykają ludzi o różnych punktach widzenia” – powiedziała.

„Boty nie dają nam tego zbyt wiele. To, co czyni je dobrymi i przypominającymi relacje międzyludzkie, to to, że potrafią wyrażać pozytywne opinie. Ale to, co sprawia, że są problematyczne, to fakt, że nie mają innego umysłu”.

Jeśli Ty lub ktoś, kogo znasz, ma trudności, oto gdzie możesz szukać pomocy:

cbc.ca